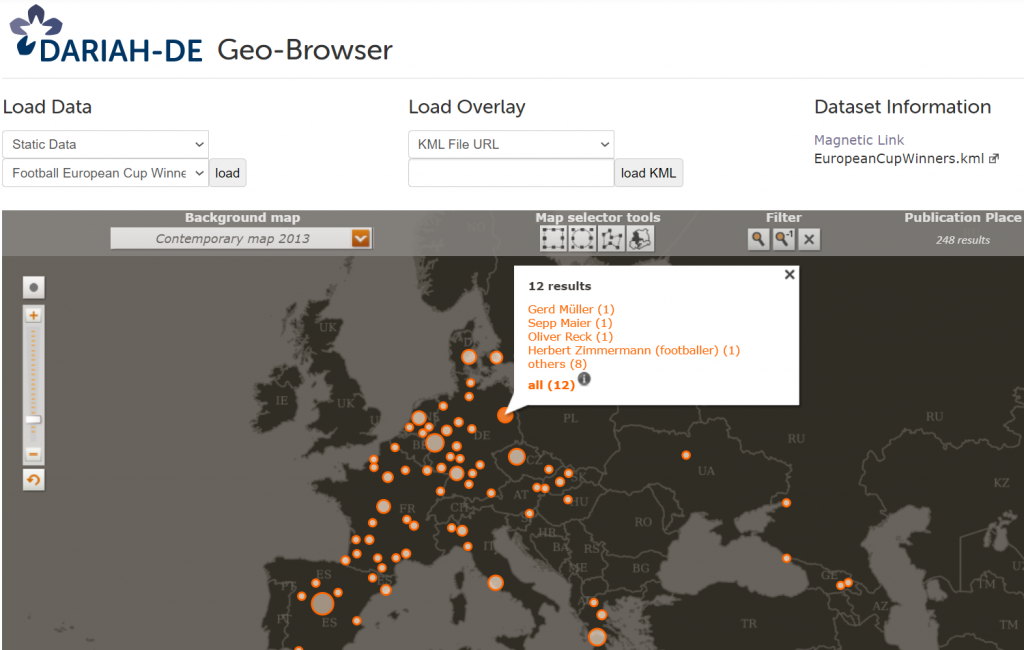

Beispielhafte Visualisierung im DARIAH-DE Geo-Browser

Mitte November werden zwei DARIAH-DE-Angebote – der Geo-Browser sowie der dazugehörige Datasheet Editor – in Version 3.6 veröffentlicht. Die damit einhergehenden Verbesserungen der beiden Werkzeuge sind im Folgenden beschrieben. Für alle Fragen rund um den DARIAH-DE Geo-Browser und den Datasheet Editor steht der CLARIAH-DE Helpdesk gerne zur Verfügung.

As of Mid November, the Datasheet Editor and the Geo-Browser will get major changes and fixes for version 3.6. They mainly relate to authentication, authorization, accessibility, and many smaller fixes aiming to improve the usability of both services.

[...]

Quelle: https://dhd-blog.org/?p=14600